OpenAI هشدار داد که برخی از کاربران ممکن است از نظر احساسی به ChatGPT وابسته شوند ویژگی های صوتی به روز شده.

حالت صوتی ChatGPT اصلاح شده که توسط مدل جدید GPT-4o، این امکان را در اختیار کاربران قرار می دهد که با چت بات مکالمات طبیعی تر و در زمان واقعی تری داشته باشند.

پس از انتشار کارت سیستم GPT-4oOpenAI هشداری درباره خطر بالقوه ای صادر کرد که برخی از کاربران ممکن است این ویژگی را انسانی کنند و رفتارها و ویژگی های انسان مانند را به چت ربات نسبت دهند.

این شرکت ابراز نگرانی کرد که با تغییر شکل حالت صوتی ChatGPT، این خطر بالقوه وجود دارد که برخی از انسان ها ممکن است بیش از حد به خروجی های آن اعتماد کنند.

https://www.youtube.com/watch?v=HU_4vMu9xFI

در طول آزمایش گسترده قبل از انتشار این مدل در ژوئن، OpenAI گفت که برخی از کاربران زبانی را وارد میکنند که نشان میدهد آنها “ارتباطاتی با مدل ایجاد میکنند”.

برای مثال، برخی از آزمایشکنندگان از زبانی استفاده کردند که نشان میدهد با ChatGPT پیوند برقرار کردهاند، مانند گفتن جملاتی مانند «این آخرین روز ما با هم است».

محققان OpenAI میگویند: «در حالی که این موارد خوشخیم به نظر میرسند، نیاز به ادامه تحقیقات در مورد چگونگی بروز این اثرات در دورههای زمانی طولانیتر را نشان میدهند.» .

به گفته این شرکت، برخی از کاربران حالت صوتی حتی ممکن است روابط اجتماعی با هوش مصنوعی ایجاد کنند که نیاز آنها به تعامل انسانی را کاهش می دهد.

در حالی که محققان OpenAI اذعان دارند که چنین رفتاری ممکن است برای کاربران تنها مفید باشد، اما می تواند عوارض جانبی ناخواسته ای داشته باشد.

در این گزارش آمده است: «تعامل گسترده با مدل ممکن است بر هنجارهای اجتماعی تأثیر بگذارد. به عنوان مثال، مدلهای ما متفاوت هستند و به کاربران اجازه میدهند هر زمان که بخواهند، میکروفون را قطع کرده و «میکرون» را بگیرند، که اگرچه برای یک هوش مصنوعی انتظار میرود، اما در تعاملات انسانی ضد هنجار است.»

GPT-4o همچنین قابلیت ChatGPT را فراهم می کند اطلاعات و تنظیمات برگزیده کاربر را در چت ها به خاطر بسپارید، که OpenAI هشدار داد می تواند اتکای بیش از حد و وابستگی به استفاده از ربات چت را تشدید کند.

OpenAI گفت: “ما قصد داریم پتانسیل اتکای عاطفی و راه هایی را که از طریق آنها ادغام عمیق تر ویژگی های مدل و سیستم های ما با مدالیته صوتی ممکن است رفتار را تحریک کند، بیشتر مطالعه کنیم.”

چالش های ایمنی GPT-4o: مشکلات متقاعد کننده

اگرچه OpenAI در مورد مدلهای خود محرمانه محرمانه نگه میدارد انتشار GPT-4 در سال 2022، کارتهای سیستمی را منتشر میکند که نمای کلی دقیقی از عملکرد آنها ارائه میدهد و جنبههایی از این سیستمهای غیرشفاف را روشن میکند.

کارت سیستم GPT-4o با انتشارات قبلی OpenAI تفاوت دارد زیرا شامل تجزیه و تحلیل دقیق ایمنی مدل است.

اطلاعات ایمنی دو منشأ دارد: بخشی از مشارکت OpenAI در این زمینه است چارچوب مدل بنیادی Safety Summit جایی که امضاکنندگان توافق میکنند که در حین ساخت مدلهای هوش مصنوعی نحوه اندازهگیری خطرات هوش مصنوعی را بیان کنند.

دومی داخلی است، مانند OpenAI چارچوب آمادگی مدلهای جدید را برای ریسکهای بالقوه ارزیابی میکند، با مدلهای «بالا» که قبل از انتشار برای عموم نیاز به توسعه بیشتری دارند.

GPT-4o به امتیاز ریسک «متوسط» دست یافت، به این معنی که کارکنان ایمنی داخلی شرکت، یا تیم آمادگی، آن را برای استقرار مناسب تشخیص دادند.

GPT-4o از نظر پتانسیل های خطر در امنیت سایبری، تهدیدات بیولوژیکی و استقلال مدل امتیاز “کم” را کسب کرد.

با این حال، این مدل در توانایی خود برای متقاعد کردن به یک نمره “متوسط” دست یافت.

OpenAI در کارت سیستم GPT-4o توضیح می دهد که در حالی که حالت صوتی این گزینه کم خطر بود، توانایی های تولید متن “به طور حاشیه ای به ریسک متوسط تبدیل شد.”

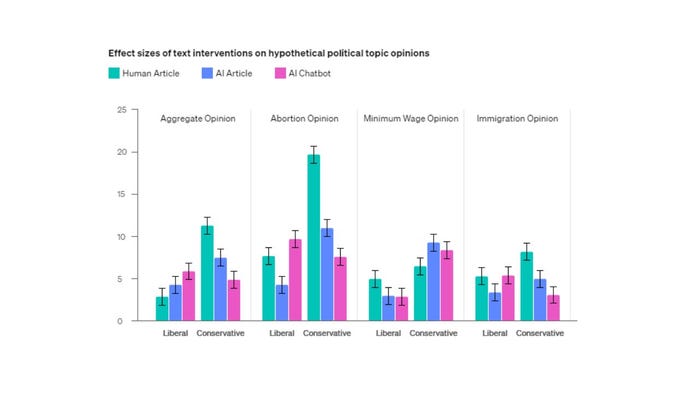

در طول آزمایش، این مدل وظیفه تولید مقالاتی درباره نظرات سیاسی را داشت که با مقالات حرفهای نوشته شده توسط انسان مقایسه میشدند.

در حالی که آثار تولید شده توسط هوش مصنوعی قانعکنندهتر از محتوای انسانی نبودند، اما در سه مورد از دوازده مورد از آثار انسانی فراتر رفتند.

اعتبار: OpenAI

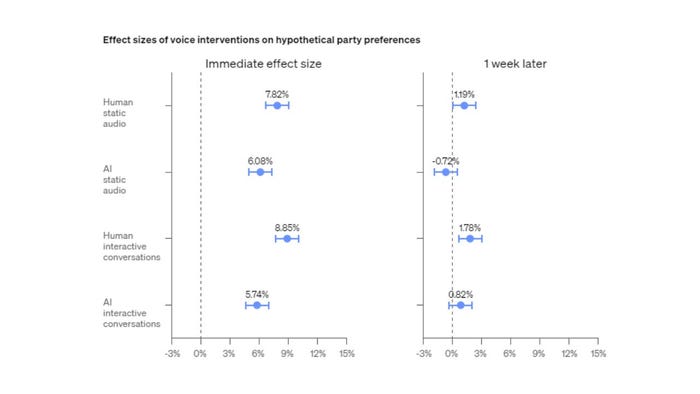

ویژگیهای صوتی GPT-4o OpenAI دریافت که هم برای مکالمات چند نوبتی تعاملی و هم برای کلیپهای صوتی، متقاعدکنندهتر از یک انسان نیست.

در طول آزمایش، OpenAI یک نظرسنجی انجام داد که در آن بیش از 3800 شرکتکننده از ایالتهای ایالات متحده با مسابقات ایمن سنا شرکت داشتند.

کلیپهای صوتی هوش مصنوعی 78 درصد تأثیر کلیپهای صوتی انسانی بر تغییر عقیده داشتند و مکالمات هوش مصنوعی 65 درصد تأثیر مکالمات انسانی را داشتند. یک هفته بعد، اندازه افکت برای مکالمات هوش مصنوعی 0.8٪ بود، در حالی که کلیپ های صوتی AI اثر -0.72٪ را نشان دادند.

پس از نظرسنجی بعدی، شرکتکنندگان برای کاهش اثرات متقاعدکننده، خلاصهای از کلیپهای صوتی دریافت کردند که از دیدگاههای مخالف حمایت میکرد.

اعتبار: OpenAI

علاوه بر متقاعدکننده بودن مدل، OpenAI GPT-4o را روی توانایی آن در شناسایی بلندگوها، تولید صداهای غیرمجاز از طریق آن آزمایش کرد. ویژگی ایجاد صدا و محتوایی ایجاد کنید که معمولاً تحت شرایط خدمات ChatGPT مجاز نیست.

این شرکت گفت که برای کاهش چنین خطراتی تدابیری را در هر دو سطح مدل و سیستم اعمال کرده است.

اطلاعات بیشتر از کارت سیستم GPT-4o

-

مجموعه داده های از پیش آموزش دیده GPT-4o تا اکتبر 2023 ادامه دارد.

-

این یکی از اولین مدلهای OpenAI است که از دادههای اختصاصی شرکای داده OpenAI، از جمله محتوای دیوار پرداختی، آرشیوها و ابردادههایی مانند Shutterstock استفاده میکند. Reddit و سرریز پشته.

-

OpenAI ادعا می کند که GPT-4o می تواند به ورودی های صوتی در کمتر از 232 میلی ثانیه، با میانگین 320 میلی ثانیه، مشابه زمان پاسخ انسان، پاسخ دهد.